不得不说,笔者整理完笔记到自己博客上写这段碎碎念的时候是又气又笑的。笑的是这是本科NLP最后一章内容了,也算是又吃下了一大本知识。气的是到底是谁想的把循环神经网络(RNN)、长短期记忆网络(LTSM)、Transformer放在一章讲完的。笔者写这章笔记头都写晕了,好多东西课上也不说,笔者为了稍微了解一下这些东西不知道在知乎和CSDN转了多少圈,最后也只能把自己粗浅的理解写下来了。记得老师上课的时候讲这章也都是在赶进度,Transformer及之后的内容跟我们说了解一下就行。也是,要是Transformer架构能像PPT那样用十几页讲完就好了。后面笔者打算沿着Transformer自学一下,不过应该另外开一个新标签专门给Transformer了。

整理完这些笔记,笔者基本对AI那些专业术语及其原理有大概的了解了,有种我好像终于跟上时代的感觉,但不得不说,我大概是学了不少了,但是这篇笔记里涉及到的最新的东西是在2018年提出的,离被称为AI元年的2025还有7年,离笔者在这写废话的时间还有8年,咱们走了很远了,但距离真正的前沿还是有距离。不得不说,计算机还真是一个要终身学习才不掉队的专业(苦笑),共勉吧。

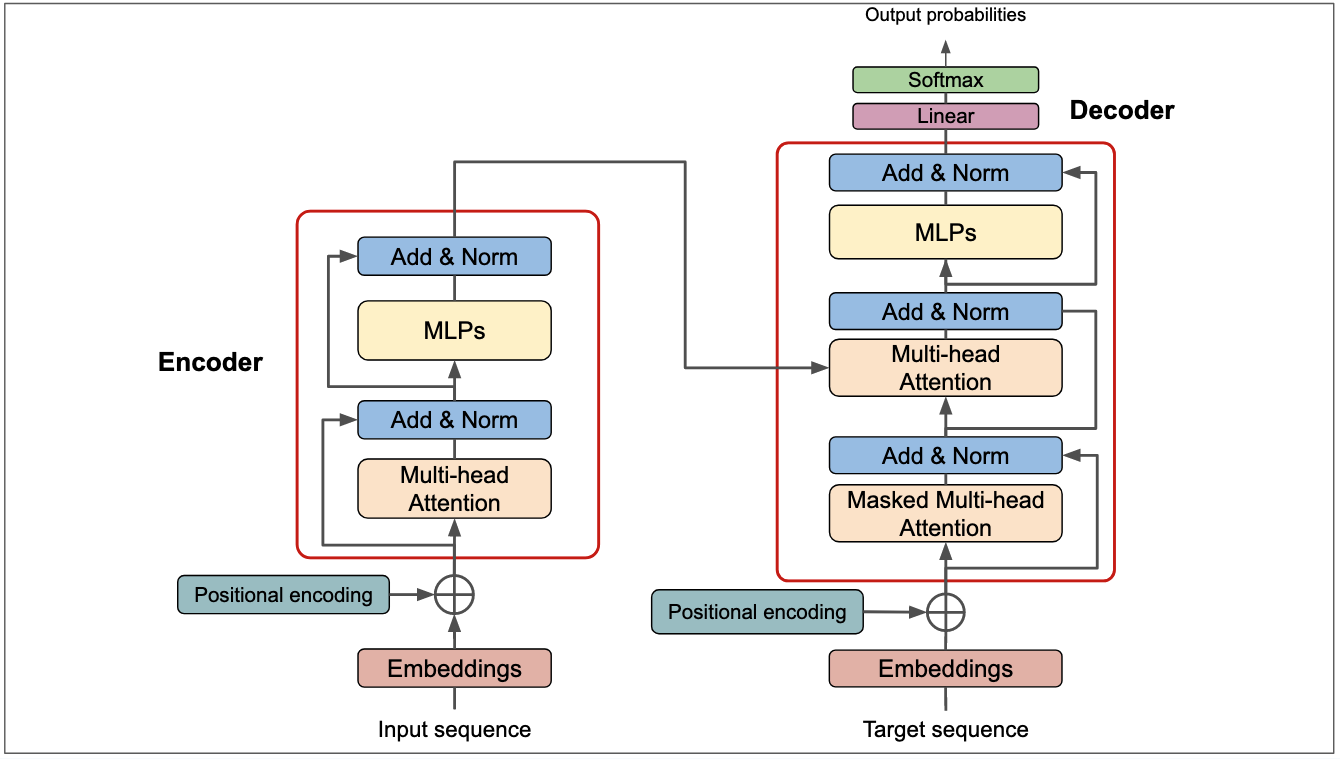

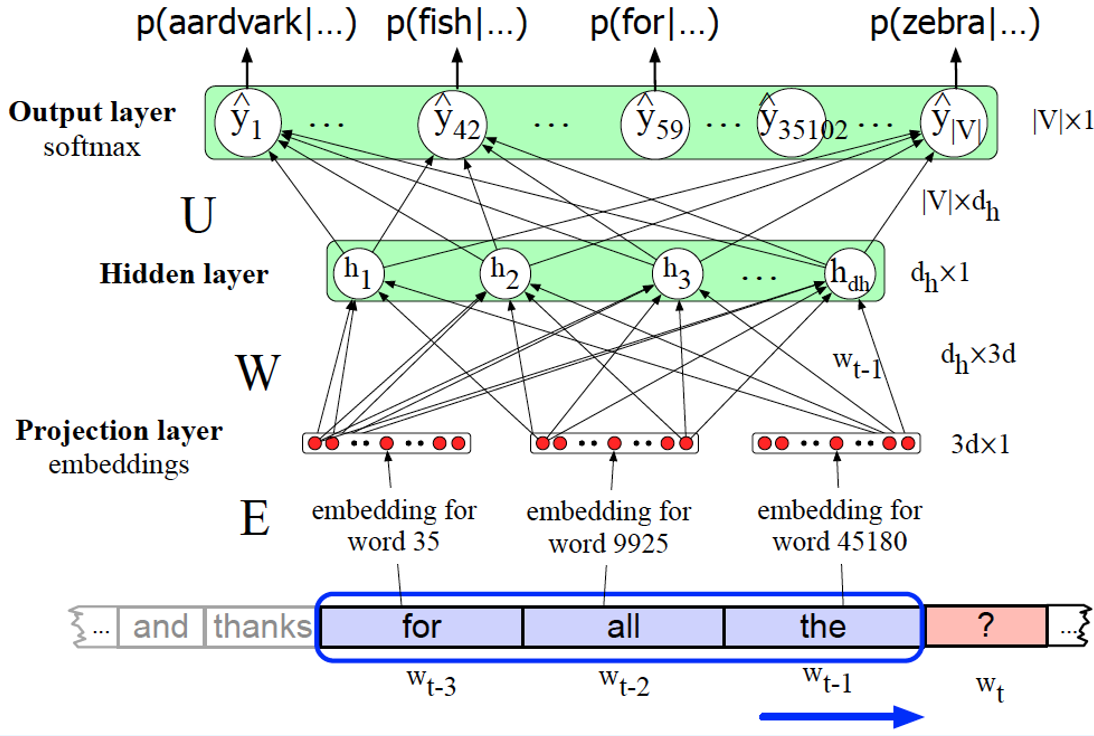

摘要:循环神经网络RNN,双向RNN / 多层RNN,LSTM 长短期记忆网络,GRU 门控循环单元,Seq2Seq(Encoder-Decoder)模型,注意力机制 Attention,自注意力 Self-Attention,多头注意力 Multi-Head,Transformer,残差连接,层归一化,BERT 模型

这里笔者也把上课的PPT发出来,有需要自取吧。